Künstliche Intelligenz, die neuen Menschen-Versteher

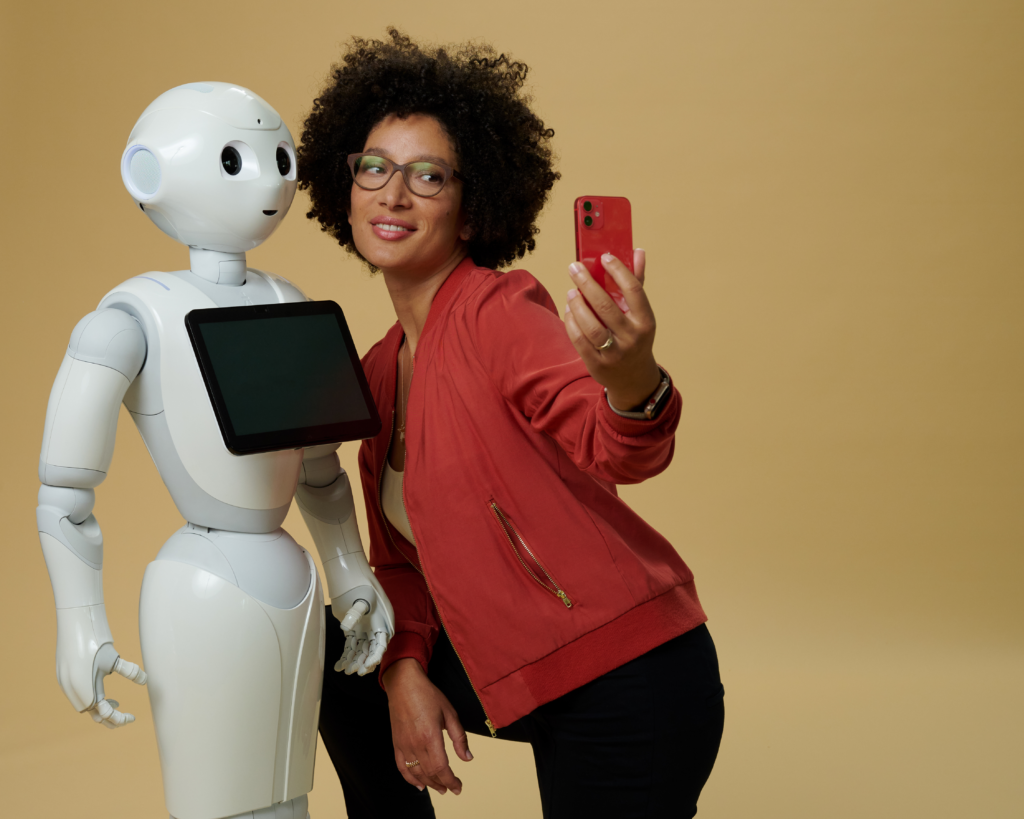

Expertin Kenza Ait Si Abbou im Gespräch über Emotionale Künstliche Intelligenz

© Hendrik Gergen

Der Erfolg von Anwendungen wie ChatGPT hat das Thema Künstliche Intelligenz (KI) auf ein ganz neues Level gehoben. Plötzlich sind Fragen nach Mensch-Maschine-Beziehungen in aller Munde. Viele Menschen haben dabei ein ganz bestimmtes Bild vor Augen, wenn sie den Begriff KI hören: Science-Fiction-Klassiker wie Terminator oder Matrix. Wer jedoch die Sprachfähigkeit des Terminators mit einem beliebigen Chatbot im Kund:innenservice vergleicht, merkt schnell den Unterschied zwischen Realität und Science-Fiction. Die renommierte Ingenieurin und eine der führenden Expertinnen für KI im deutschsprachigen Raum, Kenza Ait Si Abbou, wirft in ihrem neuen Buch „Menschenversteher“ einen Blick auf die KI-Systeme und macht deutlich, warum es so wichtig ist, dass wir kritisch über alltägliche Mensch-Maschine-Beziehungen nachdenken.

Teilweise bekommt man dabei das Gefühl, dass das Thema KI eigentlich gar nichts mit uns „Normalbürger:innen“ zu tun hat, sondern ausschließlich große Tech-Unternehmen betrifft, die außerhalb unserer normalen Bubble liegen. Jedoch kommen viele Menschen mit künstlicher Intelligenz in Berührung, manche sogar den ganzen Tag lang. Die renommierte Ingenieurin und eine der führenden Expertinnen für KI im deutschsprachigen Raum, Kenza Ait Si Abbou, wirft in ihrem neuen Buch „Menschenversteher“ einen Blick auf die Entwicklung emotionaler Künstlicher Intelligenz.

In Ihrem neuen Buch “Menschenversteher” geht es um Emotionale Künstliche Intelligenz. Was verbirgt sich hinter diesem Begriff?

Kenza Ait Si Abbou: Den Begriff Emotionale Künstliche Intelligenz wird verwendet, wenn eine Maschine aufgrund verschiedener Methoden in der Lage ist, Emotionen bei Menschen zu erkennen. Dabei geht es weniger darum, dass die Maschine selbst Emotionen oder Gefühle entwickelt – was sie nicht tut und auch nicht kann – sondern vielmehr, dass sie diese bei Menschen identifizieren, analysieren und nachahmen kann.

Wie kann sichergestellt werden, dass emotionale KI-Systeme menschenähnliche Emotionen angemessen erkennen und darauf reagieren können?

Es gibt fünf Methoden oder Indikatoren dazu, welche Emotionen ein Mensch gerade ausdrückt. Erstens die Mimik, also wie unsere Gesichtsmuskulatur sich verändert oder bewegt. Diese Methode wurde von dem Psychologen Paul Ekman klassifiziert, welcher bestimmte Muskelbewegungen mit einem Facial Action Coding System übersetzt hat – also er geht davon aus, dass bestimmte Muskelbewegungen zu bestimmten Emotionen passen. Die letzten vier Methoden sind unsere Augenbewegungen, unsere Sprache – also Tonalität, Lautsterke, Frequenz sowie Wortwahl, biologische Merkmale – wie Körpertemperatur, Herzfrequenz und Puls, und als letztes die neuronale Aktivität im Gehirn. Diese Methoden werden jedoch einzeln genutzt und nicht kombiniert, es gibt Maschinen, die können das eine und Maschinen, die können das andere. Meine These in „Menschenversteher“ ist, dass wenn Maschinen all diese fünf Methoden beherrschen, können sie Menschen noch besser verstehen, als wir es selbst tun.

Zum Nachlesen:

“Menschenversteher – Wie Emotionale Künstliche Intelligenz unseren Alltag erobert” von Kenza Ait Si Abbou, ISBN: 978-3-426-27889-5, Droemer Verlag

Sie schreiben der Einfluss “neuer Menschenversteher” sei bereits größer, als wir wahrhaben wollen. Können Sie Beispiele geben, wo in unserem Alltag sich diese finden?

KI im Allgemeinen steckt fast überall drin. Beispielsweise die Methode unserer Sprache, die auf Sentiment Analysis basiert. Bei dieser wird die Wortwahl von Menschen analysiert und hervorgesagt, was für Emotionen diese gerade beim Schreiben oder Sprechen haben. Diese Methode steckt in Chatbots zum Beispiel. Aber auch in Saugrobotern, Gesichtserkennung oder Algorithmen steckt KI.

Wir brauchen KI, die möglichst diskriminierungsfrei eingesetzt werden: unabhängig von Geschlecht, Alter, Herkunft, sexueller Orientierung oder Hautfarbe. Ist das eine utopische Vorstellung?

Das ist ein sehr komplexes Thema. Technisch gesehen, wäre es möglich möglichst diskriminierungsfreie KI’s zu entwickeln. Das Problem ist nur, sobald diese KI mit der Gesellschaft in Kontakt kommt, lernt sie Diskriminierung erneut. Da ist es nicht nur das einzige Problem, dass Entwicklungsteams meist sehr homogen sind. Wir alle sind auf eine gewisse Weise sozialisiert und dadurch, dass Gesellschaft einfach diskriminierend ist, lernt auch die KI diese Diskriminierung und reproduziert sie. Deswegen kann man schon sagen, dass es utopisch ist, dieses Problem zu lösen. Die gute Nachricht ist jedoch: Es ist viel schwieriger unbewusste Diskriminierung bei Menschen zu neutralisieren als das bei einer KI zu machen.

Emotionale Künstliche Intelligenz wird in Ländern wie Japan schon häufig im Gesundheitsbereich angewendet. Inwieweit können uns emotionale KI-Systeme im Gesundheitsbereich unterstützen?

In meinen Augen steckt in der Anwendung im Gesundheitsbereich die größten Potenziale für emotionale KI-Systeme. Beispielsweise bei der Früherkennung von psychischen Erkrankungen. Ein anderes gutes Beispiel ist die Therapie von Menschen im autistischen Spektrum mit Brillen, in denen KI steckt. Diese erkennt die Emotionen von Menschen und kann dem:der Tragenden „sagen“, wie sich das Gegenüber höchstwahrscheinlich fühlt. Das heißt eine Fähigkeit, die jemandem fehlt, wird durch eine KI unterstützt.

Warum ist das Thema Einsamkeit dabei ein wichtiges Stichwort?

Einsamkeit ist ein riesiges Problem in vielen Ländern. Conversational AI, also KI-Systeme, die mit dem Ziel gebaut sind, sich mit Menschen zu unterhalten oder sie im Alltag zu begleiten, können da ein Ansatzpunkt sein. Da geht es nicht nur um ältere Menschen, die im Altersheim leben, auch für Menschen, die allein leben oder einfach niemanden haben, ist das eine Möglichkeit. Die Kritik dabei ist oft, dass dabei Gefühle „vorgegaukelt“ werden. Diese Bewertung kommt aber in der Regel von Menschen, die von dieser Situation nicht betroffen sind. Wenn man niemanden hat, sich mit jemanden unterhalten möchte und eine Ki da ist, die hilft sich nicht allein zu fühlen, fühlen sich diese Menschen besser und das sollte ja das einzig wichtige bei dieser Diskussion sein.

Wie sehen Sie die Zukunft der emotionalen künstlichen Intelligenz? Welche weiteren Entwicklungen und Anwendungen erwarten Sie in den kommenden Jahren?

Das ist schwierig zu beantworten, ich sage immer gerne die Zukunft kommt nicht, man muss sie gestalten. Ich beobachte momentan eher welche Chancen und Risiken auf uns zukommen könnten. Meine Hoffnung ist, dass sich unsere Gesellschaft mehr Wissen zu dem Thema aneignet, kritisch damit auseinandersetzt und versucht die Nutzung in eine gesunde Richtung zu lenken. Also, dass man zum Beispiel sagt man entscheidet sich bewusst für eine Alexa, weiß dann aber, dass es die Konsequenz hat, dass diese alles mit anhört. Wenn man weiß, was für Konsequenzen bestimmte Nutzungen haben, können Menschen bewusstere und bessere Entscheidungen treffen.

KI bedeutet für unsere Welt eine monumentale Veränderung. Emotionale KI legt dabei noch einmal eine Art Turboboost ein – und das kann uns auch helfen, uns als Person und Gesellschaft weiterzuentwickeln.

-Kenza Ait Si Abbou

Was ist der Unterschied zwischen einer Künstlichen Intelligenz und einer Emotionalen KI?

Bei einer Künstlichen Intelligenz geht es viel um Mathematik wie auch Statistik. Durch den Umgang mit großen Datenmengen können Maschinen Wissen generieren und kognitive Fähigkeiten entwickeln, insbesondere im Bereich des Lernens und der Problemlösung. Die besondere Fähigkeit einer emotionalen KI ist es, dass die KI die Emotionen der Menschen erkennen, analysieren und auch nachahmen kann.